求められる憲法調和的なAIネット化

2018年07月24日

日本が、慌てている。

厳密には、日本の産業界が慌てていると言うべきだろうか。

それは、この5月25日に施行された、欧州連合(EU)の「一般データ保護規則(General Data Protection Regulation, GDPR)」が、日本人からは「行き過ぎ」と思えるような進歩的な個人情報保護規定を有し、かつ、それが欧州でビジネスを展開する多くの日本企業をも適用対象としているからである(正確には、EU域内にビジネスの拠点を置く日本企業、EUに所在する個人にサービスなどを提供する日本企業に適用される)。

例えば、このGDPRは、他の情報経済圏に先駆けて、①様々な行動記録から個人の趣味嗜好、健康状態、能力、信頼性などを自動的に予測・分析する「プロファイリング」に対し、その中止を請求する権利(21条)、②人工知能(Artificial Intelligence, AI)を用いたプロファイリング等の自動処理のみに基づいて、採用や融資の可否のような重要な決定を下されない権利(22条)、③ある企業に一旦提供した自己のデータを一定の形式で受け取ったり、これを別の企業に移転させたりすることができる「データ・ポータビリティ(可搬性)」の権利などを認め、また、④これらの権利を実効力あるものにするための透明性の確保や厳格な説明責任を企業に課している。

「プロファイリング」は、いまや多くの企業にとって、ターゲティング広告などの前提としてそのビジネスモデルの一部に組み込まれているから、この処理過程の中止を請求する権利(前記①)への対応は、企業に対して重い負担を課すことになる。また、日本でも、既に一部の企業が新卒の合否判定にAIを用いたプロファイリングを行っているし、一部の金融機関は融資額の決定に際して、申込者の信用力をスコア化するAIプロファイリングを導入している。こうした企業が仮にGDPRの適用を受けるとなると、自動処理のみに基づいて重要な決定を下されない権利(前記②)の行使への対応が求められよう。

もちろんGDPRは、採用や融資といった人生の重要場面でも、本人の明示的同意などを得て例外的にプロファイリング等による自動決定を行うことを認めている。しかしこの場合でも、企業側は、個人に対し、人間の関与を得る権利、自らの見解を表明する権利、AIの評価等を争う権利を保障しなければならないと定めており、GDPRの適用を受ける企業は、こうした権利に対応するために、やはり多大な労力とコストをかけなければならない。さらに、データ・ポータビリティの権利(前記③)についても、企業はこの権利が行使された場合、個人が持ち運びできるかたちでそのデータを当人に「お返し」しなければならないから、やはり企業側にとって大きな負担となりうる。

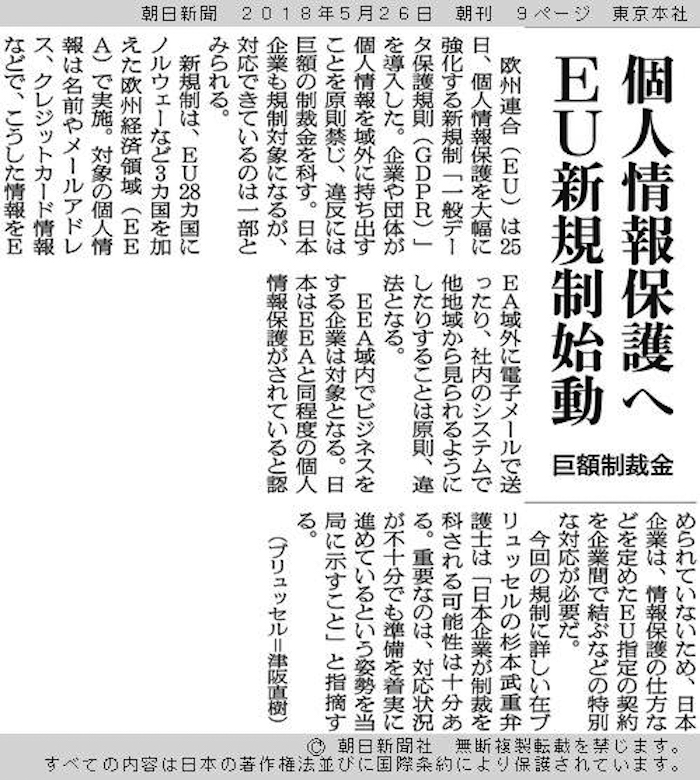

2018年5月26日付、朝日新聞朝刊

2018年5月26日付、朝日新聞朝刊しかし、憲法学を専攻する筆者から見ると、この慌てぶりは、喜劇である。GDPRの諸規定、あるいはその背景にある理念はもう何年も前からわかっていたし、少なくともその理念については、日本国憲法秩序下でとうの昔に受容しておくべきものだったからである。したがって、やや辛辣な言い方をすれば、その慌てぶりを見て、「何を今さら騒いでいるのだ」と思わずにはいられない。

もちろんここで、GDPRは既に2016年4月に欧州議会で可決されていた立法であり、2年前からその施行に向けた「心構え」だけは持つことができたはずだ、と単純に言いたいのではない。経済合理性・効率性(市場の原理)とプライバシーとのバランスを、後者にウェイトを置いた形で量るというGDPRの基本姿勢は、①EUの立法手続(手続的側面)と、②EUの基本的価値秩序(実体的側面)とに鑑みれば、その制定以前にも予想できたのではないか、ということが言いたいのである。

前記①の観点からは、EUの立法手続が――しばしば「民主主義の赤字(democratic deficit)」と批判されているように――民主主義要素を抑えられているということが重要である。EUの立法は、コミッション(日本国憲法でいう「内閣」)、欧州議会(「衆議院」)、理事会(「参議院」)という三機関が関与して行われる。詳しい説明は割愛するが、コミッションは、EUの一般的利益のために、各国政府や団体から政治的に独立していなければならないとされており(注1)、EUの立法手続においては、この政治的「独立」機関のみが立法提案権を有することになっている。そして、コミッションの立法提案を、直接選挙により選出されたEU市民の代表で構成される欧州議会と、各加盟国の閣僚級の代表で構成される理事会が承認することで、EUの立法は成立することになるのである。

ここで、EUにおける立法が、EU市民からかなり離れて行われていることに注意を払わなければならない。確かにEU市民は、直接選挙で選ぶ自らの代表機関(欧州議会)を通じて、GDPRのような立法に関与していると言えないではない。しかし、この代表機関は、そもそも立法提案権を有しておらず、政治的に独立したコミッションの立法提案に対して修正権を持つにとどまるし、欧州議会の修正案は、代表機関(選挙選出機関)ではない理事会によって覆されうる。しかも、欧州議会議員の任期は5年であるから、選挙は5年に1度しか行われず、投票率も一貫して低下してきている。こう見ると、EU市民が、「自分たちから遠く離れたブリュッセルで知らないうちに自分たちに関わる問題が決定されている」(庄司克宏)と感じるのも理解できるように思われる。

しかし、経済合理性・効率性よりも「基本的人権」を重視するような純粋(ピュア)な――ある意味で青臭い――立法は、このような「民主主義の赤字」、あるいは「民主主義からの距離」によって生まれたとも考えられる。選挙ないし選挙選出議員が立法プロセスに与える影響力が抑えられているEUでは、企業や経済団体が「選挙支援」(組織票の提供ないし政治献金)を通じて政治に容喙(ようかい)することが難しい。それゆえ、プライバシー保護のような憲法的価値を重視する純粋な立法が通りやすい状況が生まれるのである。時代を巻き戻せば、米国が憲法を制定して連邦政府を樹立する際、建国の父の一人であるマディソン(James Madison, Jr.)が、共和国の規模を拡大すれば、「党派(faction)」の結成や特殊利益の組織化が難しくなり、立法プロセスにおいて公共善が追求されやすくなると主張していたことが思い出される(注2)。この理(ことわり)はEUという現代の広域的連合体にも当てはまるからだ。

このように、選挙ないしは選挙を通じて組織化する経済的権力の影響が限定されたEUの立法プロセスの特殊性を踏まえれば、GDPRという純粋な――日本人からするとショッキングな――個人情報保護立法が制定されうることは十分に予想しえた。事業者がマーケティング目的で個人のオンライン行動を追跡することなどを厳しく規制する―EUのプライバシー立法の第2弾とでも言うべき――「eプライバシー規則(ePrivacy regulation)」も、組織化された経済的権力からある程度「超然」としていられるEUの立法プロセスを考えれば、現在施行に向けたスケジュールが遅れているものの、最終的には成立、施行という運びになるだろう。

GDPRは、EUの基本的価値秩序からも想定可能なものであった。イェール大学のホイットマン(James Q. Whitman)は、予(かね)てより、欧州では貴族の誇りやプライドに由来する「尊厳(dignity)」という観念が強く、それが、個人が誇り高く自らの情報を主体的にコントロールできなければならないという発想(情報自己決定権)に結び付くと指摘していた(他方で、貴族的伝統をもたない米国では、政府に対する住居の不可侵性を源流に持つ「自由(liberty)」という観念が強い)。

したがって、欧州においては、「プライバシー」は他者から私生活を覗き見られないという消極的なものではなく、自らの誇り、体面を汚されぬよう、その情報を自ら主体的に管理することで自身の社会的イメージ(ある種の体面)を維持または構築していくという積極的なものとして理解されるというのである(注3)。実際、ドイツでは、1983年の段階で(!)、憲法裁判所により、ドイツ連邦共和国基本法(憲法)の「一般的人格権」に関する規定(「人間の尊厳〔Wurde des Menschen〕の不可侵性」を規定する1条1項と「自己の人格を自由に発展させる権利」を保障する2条1項)を根拠に、「情報自己決定権」が承認されることになる。

「尊厳」概念と紐づく個人の主体性をベースに発展した「情報自己決定権」というアイデアは、言うまでもなく、EUのGDPRの背景になっている。例えば、プロファイリングの中止を請求する権利(21条)や、自動決定に服しない権利(22条)は、自己のデジタル・アイデンティティ(オンライン上の自己イメージ)が、専断的に収集されたデータに基づきAIによって勝手に決めつけられること、あるいは、AIに一方的に構築されたアイデンティティによって個人が自動的に仕分けされることからの自由を保障している点で、〈尊厳=個人の主体性=情報自己決定権〉というアイデアと深く関連している。

実は、自動決定からの自由は、

有料会員の方はログインページに進み、朝日新聞デジタルのIDとパスワードでログインしてください

一部の記事は有料会員以外の方もログインせずに全文を閲覧できます。

ご利用方法はアーカイブトップでご確認ください

朝日新聞デジタルの言論サイトRe:Ron(リロン)もご覧ください